Smart Manufacturing: il dato che lavora, non solo il dato che arriva.

di Andrea Spinelli, BU Manager Industry 5.0

Il vero salto di qualità — quello che separa una produzione che genera numeri da una che genera decisioni — sta nella capacità di trasformare il dato grezzo in informazione contestualizzata. E questa trasformazione richiede scelte architetturali precise, spesso sottovalutate.

Nel panorama industriale odierno, il termine “Smart Manufacturing” viene spesso abusato, quasi fosse un adesivo da apporre ogni qual volta si ha una officina con dentro un pc interfacciato ad una macchina. Per chi vive la fabbrica ogni giorno, la realtà è molto più fisica e cruda. La vera rivoluzione non risiede nell’acquisto dell’ultimo robot collaborativo o nell’installazione massiva di sensori, ma nella capacità di far parlare le macchine in modo intelligente, cercando di “capire” quello che dicono.

Molte aziende oggi si trovano in una situazione paradossale: hanno macchine che producono migliaia di dati al secondo, ma non riescono a capire nemmeno cosa stanno producendo e con quali regimi prestazionali. Estrarre un segnale da un PLC o da un sensore di vibrazioni è relativamente semplice. Il vero collo di bottiglia tecnico, però, è la contestualizzazione.

Ricevere un alert che indica un aumento della temperatura di un cuscinetto a 80°C è solo un dato. Mentre sapere che quel picco è avvenuto mentre la macchina stava lavorando una lega ad alta resistenza, con un utensile a fine vita e durante un turno iniziato da sole due ore, è informazione.

La disponibilità di un dato integrato con le informazioni di contesto, consente di attuare operazioni manutentive, in modo da evitare inattese interruzioni della produzione.

Senza contesto, il dato è solo rumore di fondo che genera falsi allarmi e incapacità risolutiva da parte dei manutentori o degli operatori.

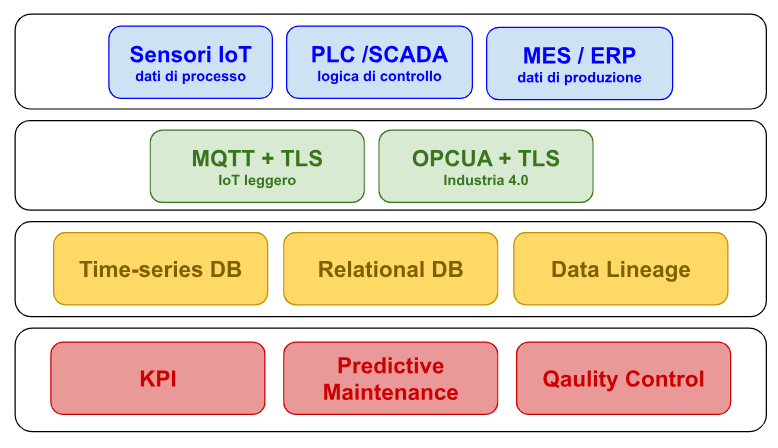

1. Il flusso del dato: dalla macchina alla decisione

Dobbiamo portare quindi il dato lungo un viaggio verso un suo uso più intelligente, l’uso da parte di analisi statistica multivariata, deep learning e AI. Questo viaggio ha però delle condizioni di partenza, essenziali per la rapidità del processo di costruzione della conoscenza.

Comprendere questo flusso è fondamentale per chiunque voglia progettare un’architettura industriale che non sia solo connessa, ma governabile. Ogni livello introduce decisioni tecniche che hanno impatti diretti su aspetti di sicurezza, gestionali e spesso anche normativi

2. Le basi di partenza

Digitalizzare il controllo di processo produttivo, affinché sia realmente basato sui dati, richiede alle aziende un investimento significativo di tempo, di risorse e di visione strategica. Purtroppo l’investimento da solo non basta: affinché il progetto porti risultati economici misurabili (come la riduzione dei tempi di fermo macchina, la diminuzione degli scarti, il contenimento degli sprechi di materie prime e risorse energetiche), è necessario affrontare con consapevolezza una serie di scelte che, a prima vista, possono sembrare puramente tecniche, ma che hanno ripercussioni profonde sulla sicurezza, sulla governance e sulla competitività dell’organizzazione.

Scegliere come trasmettere un dato, dove archiviarlo, chi può accedervi e come tracciarne il ciclo di vita non sono decisioni da delegare al solo reparto IT. Sono decisioni che determinano la qualità di ciò che il sistema è in grado di restituire: non semplici input grezzi, ma informazioni contestualizzate che si trasformano in conoscenza, e la conoscenza in decisioni operative e strategiche. È questa catena, dal dato alla decisione, che crea il grande divario che c’è fra una fabbrica semplicemente connessa e una fabbrica intelligente.

Di seguito vorrei guardare essenzialmente il primo anello importante della nostra catena del dato, quello che definirei lo stato grezzo del dato. Andiamo a vedere 4 aspetti fondamentali del dato: come ci arriva, come lo conserviamo, come lo forniamo agli altri e come teniamo traccia del suo passaggio.

2.1 Trasmissione del dato

Connettere macchine significa aprire superfici d’attacco. Per questo motivo, la scelta del protocollo di trasporto non è una questione puramente tecnica, ma anche di governance del rischio.

MQTT con TLS è oggi lo standard di fatto per la maggior parte dei dispositivi IoT industriali: leggero, ampiamente supportato, cifrato end-to-end.

OPC UA va oltre, integrando nel protocollo stesso meccanismi di autenticazione tramite certificati x.509, firme digitali e cifratura, rendendolo la scelta naturale per gli ambienti Industria 4.0 che richiedono interoperabilità tra macchine eterogenee.

2.2 Storage del dato

Come in tutte le cose, non esiste un unico database adatto a tutti gli scenari IoT. La scelta dipende da un trade-off preciso tra latenza di scrittura, capacità di query su serie temporali, scalabilità e requisiti di conformità. Per la telemetria continua, temperature, pressioni, vibrazioni campionate a cadenza regolare, i database time-series più comuni sono InfluxDB e TimescaleDB: compressione ottimizzata, query veloci su intervalli temporali, retention policy configurabili.

2.3 Riservatezza e controllo accessi

Proteggere il dato industriale significa agire su due fronti distinti: durante il transito e durante la memorizzazione.

In transito, la cifratura TLS/SSL copre la maggior parte dei protocolli applicativi. Dove il perimetro di rischio è più ampio, le VPN industriali su OpenVPN proteggono l’intero canale tra edge e cloud. Una volta arrivati al database i dati, la cifratura AES-256 dei volumi di storage è oggi considerata il minimo accettabile. Per i dati particolarmente sensibili, come dati personali degli operatori o segreti industriali, la cifratura a livello di colonna permette di proteggere selettivamente solo i campi critici, riducendo la superficie di esposizione.

Sul fronte del controllo degli accessi si deve cercare di seguire il principio del minimo privilegio, per cui ogni sistema, umano o macchina, accede solo ai dati strettamente necessari alla propria funzione.

2.4 Tracciabilità del dato

In smart manufacturing, la tracciabilità non è un tema normativo accessorio: è un requisito operativo. Le normative GDPR, ISO 27001, NIS2 e IEC 62443 convergono tutte su un principio comune: ogni dato deve avere una storia verificabile.

L’obiettivo finale di questa infrastruttura non è la tecnologia fine a se stessa, ma l’ottimizzazione ed il controllo. La Smart Factory è quel luogo dove il responsabile di produzione può vedere in tempo reale non solo se una macchina è ferma, ma perché lo è, confrontando automaticamente le performance storiche con quelle attuali; oppure dove un picco anomalo di temperatura viene correlato immediatamente al lotto in lavorazione, all’utensile montato, all’operatore in turno; oppure ancora, dove l’audit di conformità non è un’operazione manuale da settimane, ma una query su un sistema che ha registrato tutto, sempre, in modo verificabile.